LM1 라우드니스 메타데이터로 스트리밍 광고 음량 규제(SB 576)를 준수하는 방법

1. SB 576과 영상 스트리밍 서비스의 과제

미국 캘리포니아 주에서는 2026년 7월 1일부로, 영상 스트리밍 서비스를 제공하는 사업자가 자사 플랫폼을 통해 제공하는 광고의 음량이 본편(프로그램)의 음량보다 높아서는 안 된다는 내용의 법안 SB 576(“본편보다 높은 음량의 광고 송출을 금지하는 법안“)이 발효됩니다(관련 블로그). 이는 기존에 TV·케이블 방송에 적용되던 CALM Act(Commercial Advertisement Loudness Mitigation Act)의 규제를 스트리밍 서비스까지 확대한 조치입니다. 결국, 넷플릭스나 디즈니플러스 같은 스트리밍 사업자들은 광고 음량을 본편과 동일하거나 낮은 수준으로 제어하는 기술적 준비가 필수적입니다.

2. 왜 SB 576 대응에 LM1이 유리한가

SB 576은 광고 음량이 본편보다 커서는 안 된다는 ‘음량 상한 규제’입니다. 스트리밍 사업자 입장에서는 다음과 같은 도전이 존재합니다:

-

광고와 본편이 서로 다른 라우트(서버/플랫폼)로 구성될 수 있고, 광고 삽입 시 두 음량 간 밸런스가 맞지 않을 수 있음

-

콘텐츠 제작 주체가 다르기 때문에 각 트랙의 실제 음량 정보를 정확히 알기 어려움

-

다양한 단말(Device), 재생 환경(앱, 스마트TV, 모바일 등)에 따라 ‘같은 음원이라도 체감 음량’이 달라질 수 있음

-

기존 방송처럼 단일 환경이 아닌 OTT/스트리밍 환경에서는 실시간 삽입(DAI), 변환, 인코딩 과정이 다양해 일관된 음량 관리가 어려움

이때 LM1의 메타데이터 기반 방식을 활용하면 다음과 같은 이점을 얻을 수 있습니다:

-

광고 서버가 광고 음원에 LM1 메타데이터를 생성하여 사이드체인으로 함께 전송하면, 단말이 본편의 음량 메타데이터와 비교해 광고 재생 시 본편의 음량 레벨과 비교해 실시간으로 동적으로 제어 수행

-

서버는 광고를 별도 리마스터링할 필요가 없어 운영 비용과 복잡성이 크게 감소

-

단말에서는 메타데이터에 따라 광고 음량을 본편과 동일 또는 낮게 조절하는 로직 추가만으로 자동 음량 평준화 구현 가능

-

결과적으로 모든 디바이스와 플랫폼에서 통일된 사용자 경험 제공

-

LM1이 국제표준인 ANSI/CTA-2075.1에 반영되어 있어, 기술 신뢰성과 규제 대응 측면에서 모두 검증된 솔루션임

즉, LM1은 SB 576 준수와 사용자 경험 향상, 그리고 운영 효율성을 동시에 해결하는 가장 확실하고 검증된 솔루션입니다.

3. 기술 배경: LM1이란 무엇인가

LM1은 Gaudio Lab이 개발한 메타데이터 기반 음량 평준화(Loudness Normalization) 기술로, 방송/스트리밍 등 다양한 환경에서 콘텐츠 음량을 일관되게 유지하도록 설계되어 있습니다.

주요 특징

- 표준화 기술

- 한국정보통신기술협회(TTA) 표준 TTAK.KO-07.0146 (2020) 제정

- ANSI/CTA-2075.1(OTT 및 온라인 비디오 배포용 음량 표준) 반영

- 사이드체인 메타데이터 구조

- 프로그램당 1KB 미만의 경량 비트스트림으로 구성

- 단말은 메타데이터를 참조해 재생 중 실시간 음량 보정 수행 (원본 음원 손실 없음)

- 정확도 및 성능

- ITU-R BS.1770 (최신 ITU-R BS.1770-5 까지 지원) 국제 표준 방식으로 음량 측정

- Zero Latency Process (Peak Limiter 사용 시 지연 0.001 sec 이하)

- Dialogue (Anchor) Normalization, Transparent Mode, Quality Secure Mode 등 다양한 평준화 모드 및 고급 기능 제공

- 서버/단말 모두 저연산 구조로, 클라우드/앱 환경에 최적화

- 모든 단말/앱/플랫폼 지원: 스마트폰/TV/웹/전장/Embedded 등

- 고객사의 워크플로우, 단말/앱 구조에 맞춘 custom integration 지원

- 5천만 명 이상 사용자가 일상적으로 활용 중인 검증된 기술

4. 동작 구조

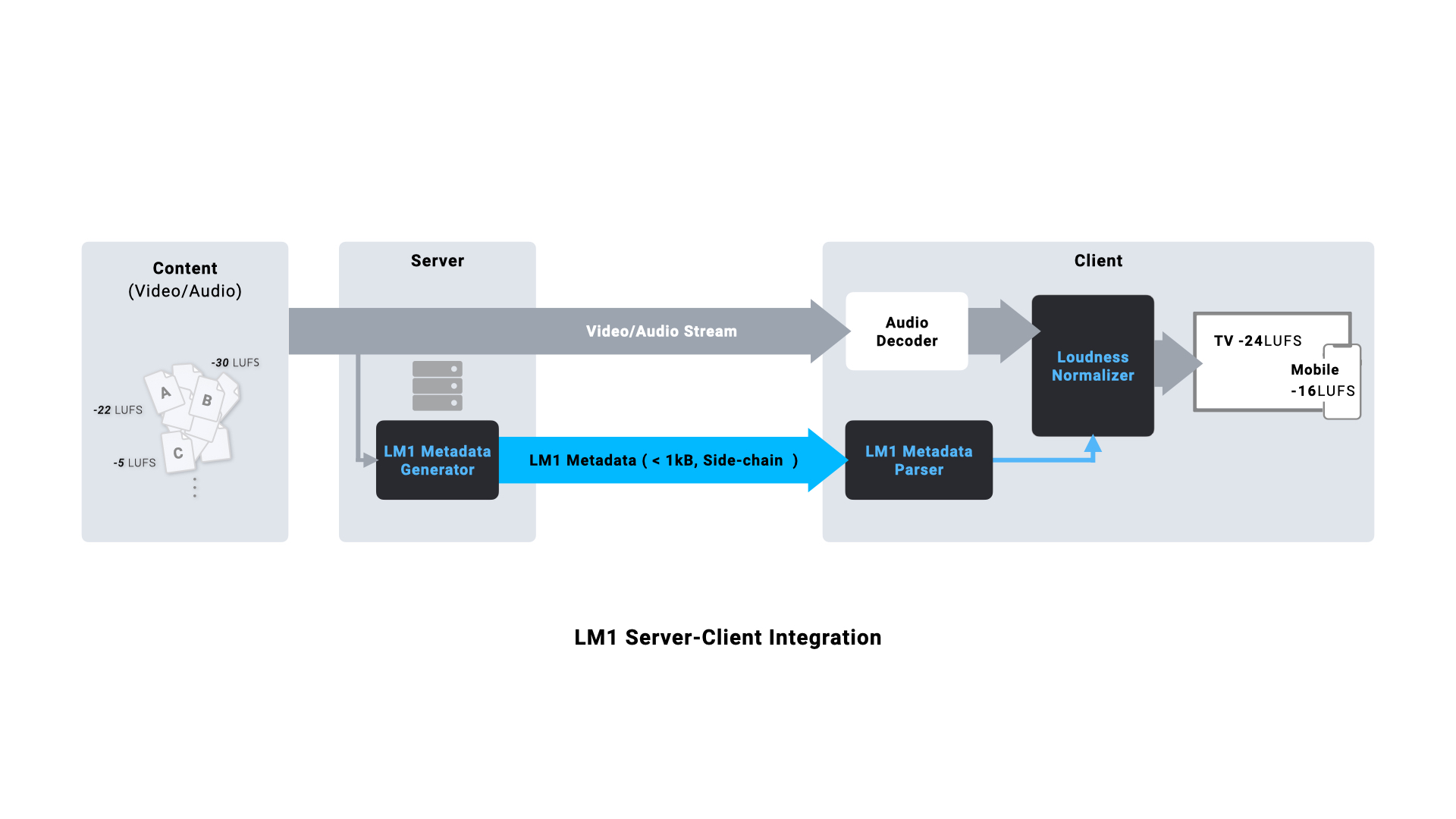

먼저, 아래 그림은 LM1 서버-클라이언트 구조의 음량 평준화 솔루션의 동작 구조를 설명하는 다이어그램입니다.

[그림 1: LM1 서버-클라이언트 구조]

LM1은 서버에서 콘텐츠(오디오/비디오)의 음량 정보를 측정해 사이드체인 메타데이터(LM1 Metadata) 형태로 생성하고, 클라이언트 단에서 이를 이용해 재생 시 실시간으로 음량을 보정하는 구조입니다.

- 메타데이터 생성

- 서버의 LM1 Metadata Generator는 각 콘텐츠의 음량을 국제 표준 ITU-R BS.1770 방식으로 측정 및 분석하여, 각 콘텐츠마다 1 KB 미만의 LM1 메타데이터를 생성합니다.

- 전송 (Sidechain)

- LM1 메타데이터는 오디오 스트림과 함께 별도의 사이드체인으로 클라이언트에 전송됩니다. 이때 메타데이터는 ID3 테그나 Timed Metadata 형식으로 포함할 수 있습니다. Timed Metadata의 경우 HLS 환경에서는 EXT-X-ID3, DASH 환경에서는 emsg 태그를 통해 전달됩니다.

- 클라이언트 처리

- 클라이언트는 오디오 디코더로 음원을 재생하면서, LM1 메타데이터를 파싱해 Loudness Normalization을 수행합니다.

- 예를 들어, TV에서는 −24 LUFS, 모바일에서는 −16 LUFS 등 재생 기기에 맞춘 최적의 음량으로 출력되어, 모든 환경에서 일관된 음량과 쾌적한 청취 경험을 제공합니다.

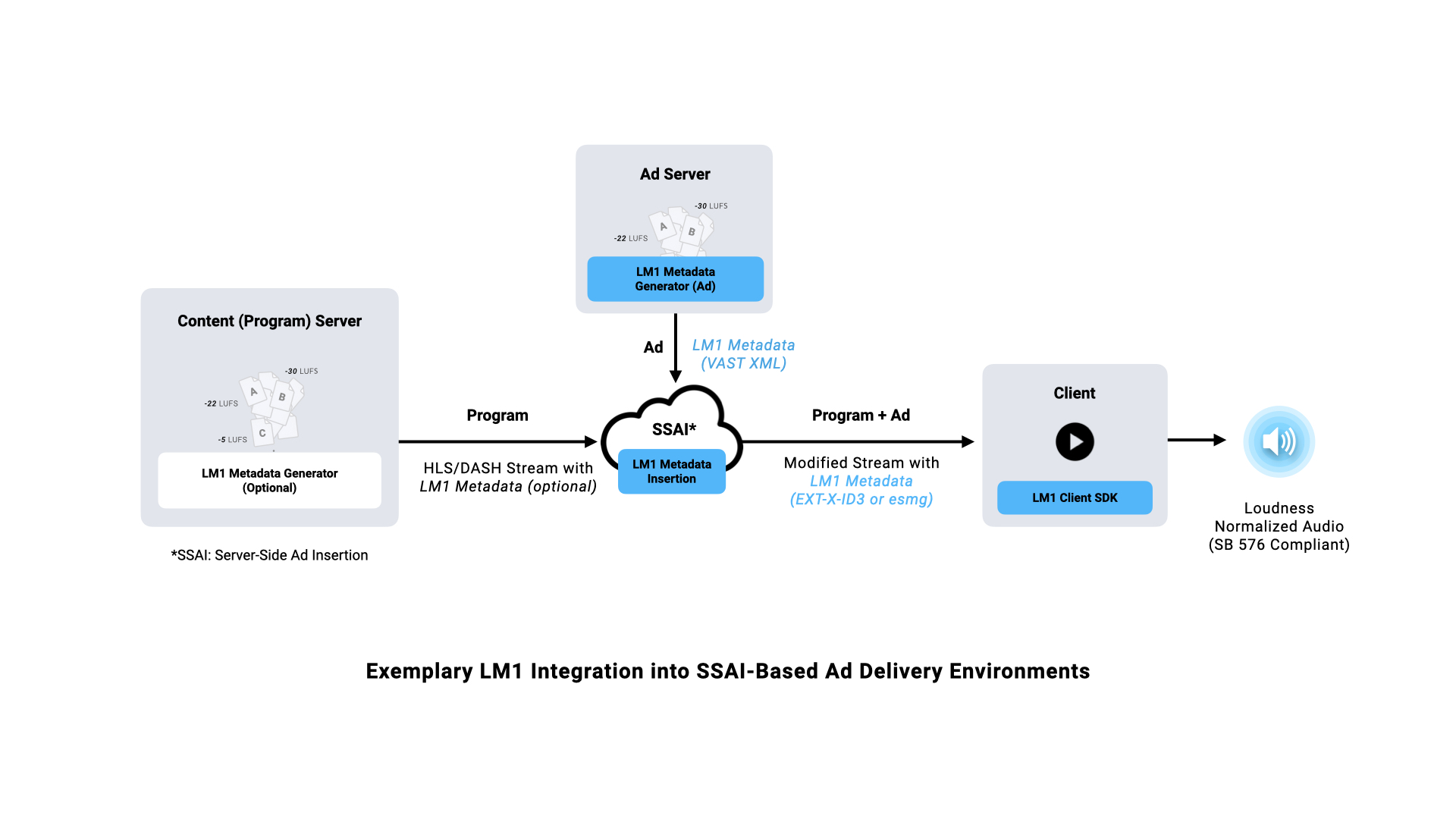

다음 그림은 스트리밍 서비스 사업자가 LM1 메타데이터 기반으로 SB 576 요건을 충족하기 위해 설계할 수 있는 스트리밍/광고/단말 관계도의 예시입니다. 여기서는 서버 사이드 광고 삽입(SSAI) 방식으로 통합되는 경우를 기준으로 설명합니다만, 클라이언트 사이드 광고 삽입(CSAI) 방식에서도 문제없이 적용 가능합니다.

[그림 2: SSAI 환경에서의 LM1]

- 콘텐츠 서버 (Program Content)

- 본편 오디오의 음량을 측정하여 LM1 메타데이터를 생성합니다. 생성된 메타데이터는 Timed metadata에 포함되어 전송됩니다. 본편 오디오의 라우드니스를 이미 특정 목표값에 맞춰 평준화한 서비스의 경우 별도의 LM1 메타데이터를 생성 및 전송할 필요가 없습니다.

- 광고 서버 (Ad Server)

- 광고 서버는 광고 오디오의 라우드니스를 분석하여 LM1 메타데이터를 사전에 생성합니다. 이후 광고 콘텐츠 전송시 LM1 메타데이터를 기존의 메타데이터(광고 URL, ID, 재생 길이, 트래킹 정보 등)와 함께 Extension 필드에 포함한 VAST XML을 SSAI 서버에 제공합니다.

- SSAI 서버 (Ad Assembler)

- SSAI 서버(Ad Assembler)는 본편 콘텐츠 스트림과 광고 스트림을 하나의 연속된 재생 스트림으로 구성합니다. 내부의 Manifest Stitcher는 HLS/DASH manifest를 기반으로 본편과 광고 세그먼트를 정렬하고, Ad Server로부터 전달받은 LM1 메타데이터를 Timed Metadata(EXT-X-ID3, emsg) 형태로 변환하여 광고 삽입 시점마다 manifest에 삽입합니다.

- 클라이언트 (플레이어 + LM1 SDK)

- 클라이언트는 LM1 Client SDK를 통해 프로그램(optional)과 광고의 메타데이터를 읽어서 라우드니스를 보정하여 모든 구간에서 동일한 음량 레벨을 유지하도록 자동 제어합니다.

이 구조를 통해 광고 삽입 환경에서도 SB 576 규제에 완벽히 부합하는 음량 관리를 달성할 수 있습니다. 또한 LM1 메타데이터는 오디오 코덱과 무관(Codec Agnostic)하게 동작하므로, 기존 SSAI 파이프라인의 구조를 변경하지 않고도 쉽게 통합 가능합니다.

왜 사이드체인 메타데이터 방식인가

- 메타데이터로 참조 정보만 전달하고 원본 자체를 변경하지 않으므로 오디오 품질 손실이나 리마스터링, 트랜스코딩의 부담이 없음

- 기존 인프라에 최소한의 변경만으로 적용 가능

- 광고/프로그램 각각 별도 메타데이터를 관리, 삽입하므로 각각의 운영 주체가 달라도 호환성 보장 → 각 서비스 플랫폼마다 서로 다른 기준 음량을 갖는 경우에도 동일한 광고 파일 하나로 대응 가능

- 코덱 독립적(Codec Agnostic) → AAC, AC-3 등 서로 다른 코덱으로 인코딩된 콘텐츠들 사이에서도 동일하게 동작

- 서버에서 실제 콘텐츠를 측정해서 생성하므로 신뢰도 100% – 과거에는 잘못된 음량 메타데이터로 인한 오류 위험 때문에 사용되지 않음

- 이미 다양한 플랫폼에 적용되어 단말 확장성 우수

Wrap-up

SB 576 이 사용자에게 큰 편의를 줄 수 있는 좋은 규제임에도 불구하고, 이를 사업자 입장에서는 새로운 기술적 부담으로 작용할 수 있습니다. 실제로 Netflix, Disney 등 주요 사업자들을 대변하는 Motion Picture Association and the Streaming Innovation Alliance 측에서도 해당 법안의 실질적 구현 어려움에 대해 우려를 표한 바 있습니다.

그러나 LM1은 이러한 구조적 문제를 이미 예견하고 설계된 표준 기술입니다. 2020년 표준 제정 당시부터 방송/OTT/광고 생태계 전반의 음량 불균형 문제를 근본적으로 해결하기 위해 만들어졌습니다.

이 글을 읽고 궁금한 점이 있거나 솔루션을 상담하고 싶은 분들은 언제든 Contact Us 링크를 통해 문의해 주시기 바랍니다.